robots.txt是搜索引擎中访问网站的时候要查看的第一个文件,它告诉蜘蛛程序在服务器上什么文件是可以被查看的。当一个搜索蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围;如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被口令保护的页面。

由于AdSense广告是通过使用一个AdSense的网页检索器来显示的,这种蜘蛛程序根据具体的关键字扫描你的网页内容,并决定要显示哪些广告,所以如果在AdSense蜘蛛程序被你的robots.txt文件阻止,那么在你的网站上显示相关的广告将会是件很困难的事情,因此用户可能会看到很少的相关广告,从而导致点击率较低。

对此,发布者需通过[yourdomain.com]/robots.txt查看你的robots.txt文件的内容,(如果你有一个子域名,它可能也有一个robots.txt文件,位于[sub.yourdomain.com] / robots.txt),确保该文件的设置允许AdSense广告的蜘蛛程序查看你的网站。你可以在文件的顶端加入以下两行:

User-agent: Mediapartners-Google

Disallow:

这将确保AdSense广告的蜘蛛程序可以访问你的网站,并有助于展示更多相关广告,从而使你从中受益。这种变化不会影响你的谷歌搜索排名,没有AdSense广告代码的页面也不会受到影响。

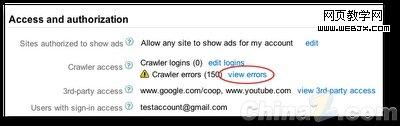

另外,如果你有任何错误的网址,可以登录你的AdSense帐户,点击主页上的“帐户设置”,从那里点击“访问和授权”下的“查看错误”即可查看。(糖糖)